龙虾🦞OpenClaw,消耗Tokens的速度快到一眨眼钱包就空了,如何永久有效的使用免费tokens ?

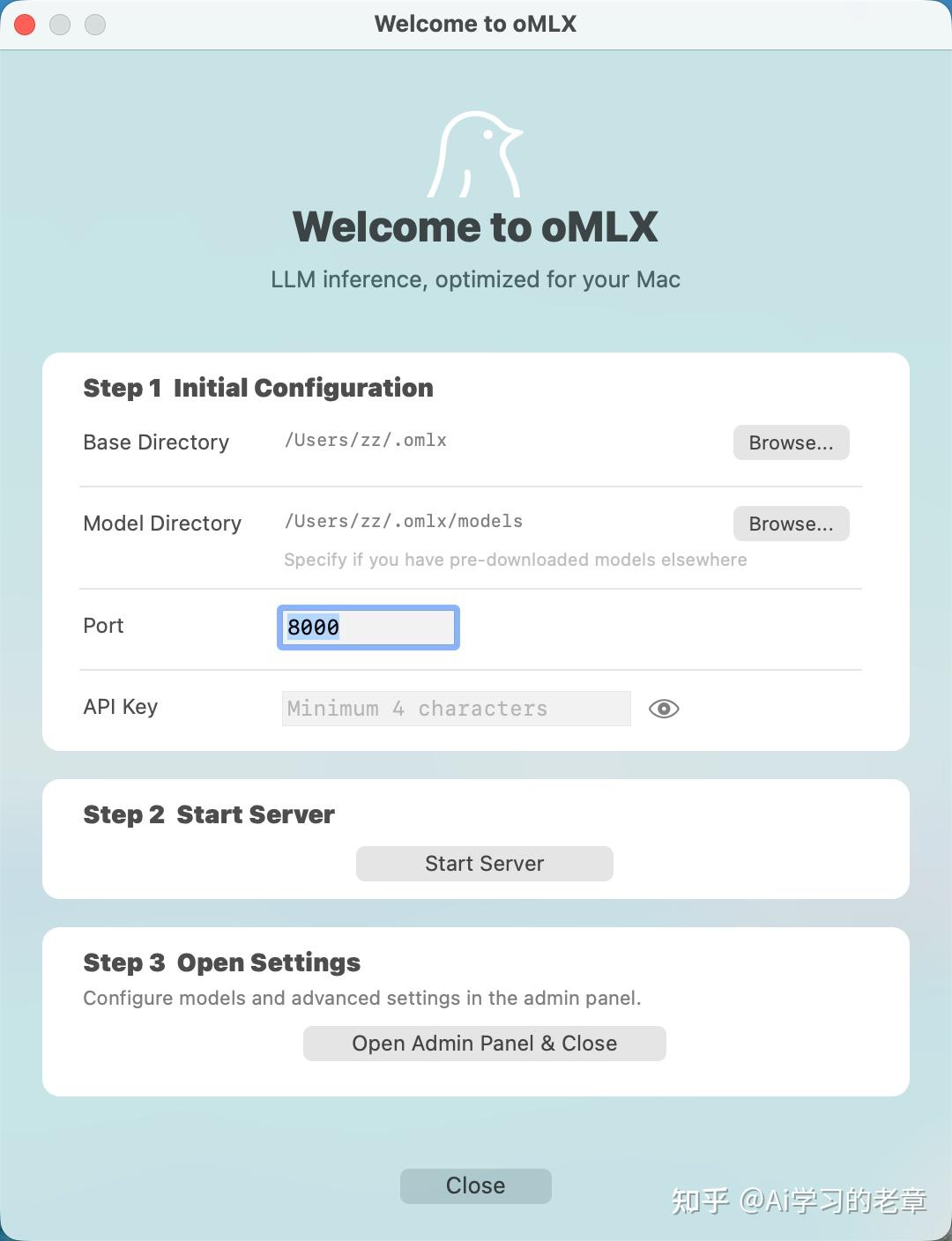

我们用最快的方式在自己的电脑上部署大模型。

分两步:

第一步:部署Ollama

第二步:部署Open WebUI

- 做完第一步,可以运行大模型。

- 做完第二步,可以拥有像ChatGPT、DeepSeek类似的网站(还可以分享给别人使用),增强体验。

第一步:部署Ollama

1、下载

打开Ollama官网“https://ollama.com/”,下载

2、启动

双击启动,之后在任务栏上有个图标,跟下图是一样的

3、使用

运行命令

ollama run deepseek-r1:1.5b

- ollama会自动下载模型并运行。

- deepseek-r1:1.5b的意思是:DeepSeek的R1版本的模型,数据量1.5B(补充:实际1.8B)

纯CPU运行,也不会占用很多内存,约2~3GB(详情见:“其他” – “负载”)

第二步:部署Open WebUI

1、安装

pip install open-webui2、运行

open-webui serve

3、使用

用浏览器打开“http://localhost:8080” ( 或者 “http://127.0.0.1:8080”)

这是使用界面(左上角选模型,做完第一步,你可以选“deepseek-r1:1.5b”)

现在你可以开始聊天。

其他

1、说明

deepseek-r1:1.5b这个模型的特点是:需要电脑配置很低、速度很快、会犯飘,很适合:协助处理文本。

- 不能做复杂的推理,比如:“证明地球为什么是圆的”、“证明地球为什么不能是方的”。

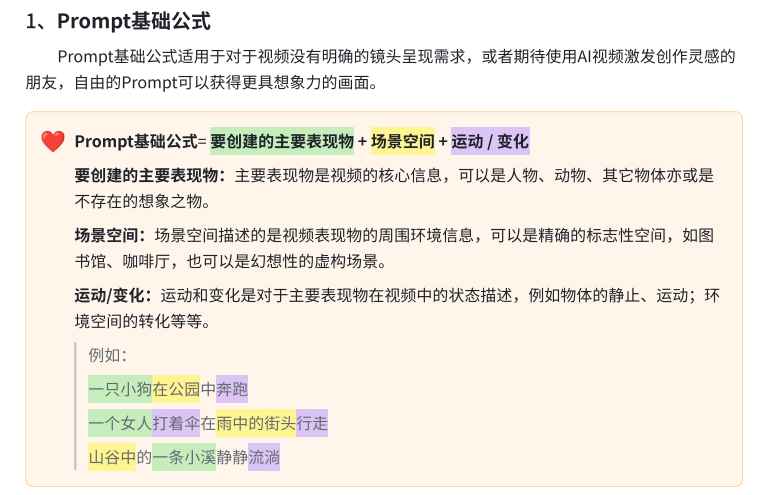

举例 1:协助处理文本。让它做总结。

举例 2:让它整理成你需要的样式。

意外的为了画柄图它能写出代码,可惜代码执行器还没配好——报错了

于是我用了“代码解释器”这个能力,读下来没什么问题,要看执行之后的效果,加到“接下来的研究”中。

2、负载

纯CPU运行,以下是CPU的占用率

也不会占用很多内存,约2~3GB,看下图

3、处理报错

- 先检查版本(python对应pip、python3对应pip3)

python3 -- version

python -- version

pip3 -- version

pip -- version- pip执行出错,升级python到3.11。(以下命令安装 Python 时,也会安装 pip。)

pyenv install 3.11注意:有人安装时注册的命令是“python3”和“pip3”

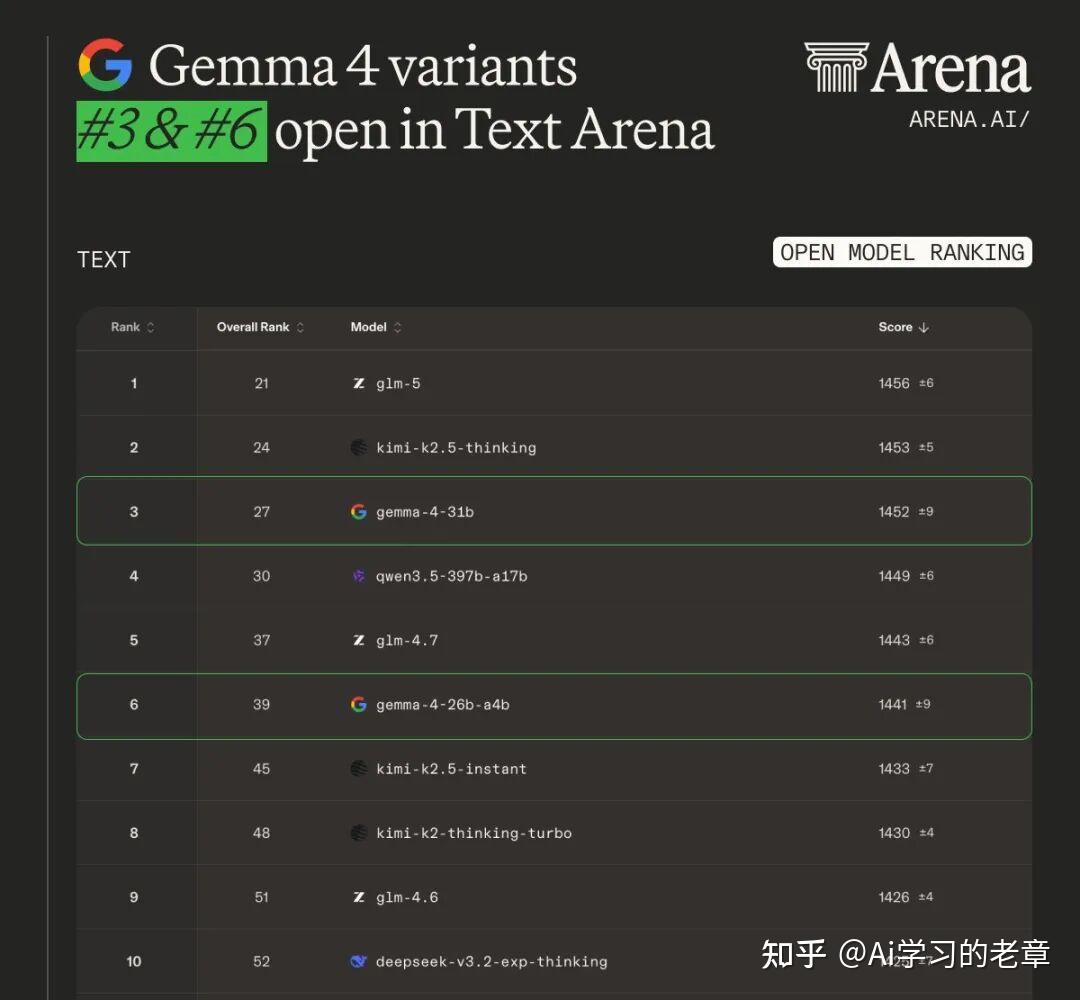

4、哪个模型好用

目前测试了7个大模型:

- deepseek-r1:1.5b

- deepseek-r1:7b

- deepseek-r1:8b

- deepseek-r1:14b

- deepseek-r1:32b

- gemma3:4b

- llama3.2:3.2b

体验最好的是“llama3.2-3.2B-Q4”

接下来研究什么

要在电脑上部署大模型,需要解决的问题有3个:

- 是否可行

- 怎么做

- 拓展功能

本次解决了第2个问题 —— 怎么做。

接下来要解决 “3、拓展功能”

如何加速模型推理 —— 利用电脑上的显卡资源

如何把文件转换为知识库 —— 供模型调阅

如何微调模型 —— 让它不再飘

配置Open WebUI的代码执行器 —— 让AI写的代码能直接运行

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容